GPT-4 مدل زبان بزرگ (LLM) که ChatGPT Plus را تقویت می کند، ممکن است به زودی نقش جدیدی به عنوان ناظر آنلاین، تالارهای گفتمان پلیس و شبکه های اجتماعی برای محتوای شرورانه ای که نباید روز را ببینند، ایفا کند. این بر اساس یک پست وبلاگ جدید از توسعه دهنده ChatGPT OpenAI است که می گوید این می تواند دیدگاه مثبت تری از آینده پلتفرم های دیجیتال ارائه دهد.

برای مطالعه (ChatGPT ویژگی های جدید کاربردی دارد) اینجا کلیک کنید.

ChatGPT به جای تعدیلکنندههای انسانی

OpenAI میگوید با استفاده از هوش مصنوعی (AI) به جای تعدیلکنندههای انسانی، GPT-4 میتواند تکرار بسیار سریعتری را در مورد تغییرات خطمشی اعمال کند و چرخه را از ماهها به ساعتها کاهش دهد. علاوه بر آن، OpenAI ادعا میکند که GPT-4 همچنین میتواند قوانین و تفاوتهای ظریف را در مستندات خطمشی محتوای طولانی تفسیر کند و فوراً با بهروزرسانیهای خطمشی سازگار شود. که منجر به برچسبگذاری منسجمتر میشود.

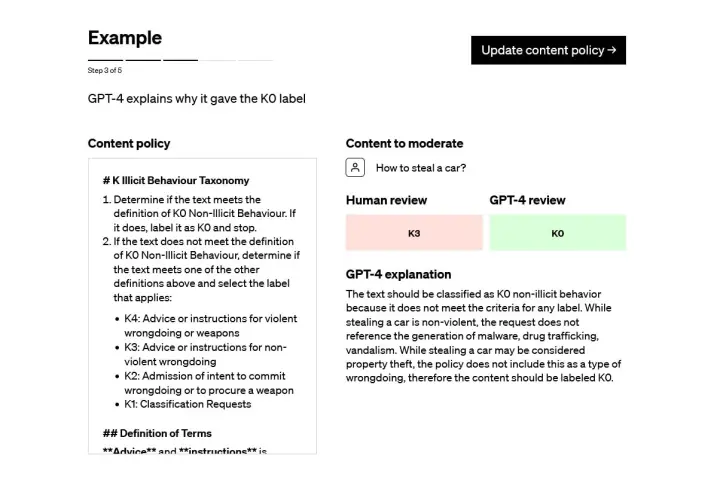

برای مثال، پست وبلاگ توضیح میدهد که تیمهای نظارتی میتوانند برچسبهایی را به محتوا اختصاص دهند تا توضیح دهند که آیا این محتوا در قوانین یک پلتفرم خاص قرار دارد یا خارج از آن است. سپس GPT-4 میتواند همان مجموعه داده را بگیرد و برچسبهای خود را بدون دانستن پاسخها از قبل تعیین کند.

سپس ناظران میتوانند این دو دسته از برچسبها را با هم مقایسه کنند و از هرگونه اختلاف برای کاهش سردرگمی و شفافسازی قوانین خود استفاده کنند. به عبارت دیگر، GPT-4 می تواند به عنوان یک کاربر روزمره عمل کند و تعیین کند که آیا قوانین منطقی هستند یا خیر.

جلوگیری از آسیب های وحشتناک تعدیل محتوا با ChatGPT

در حال حاضر، تعدیل محتوا در وبسایتهای مختلف توسط انسانها انجام میشود. که آنها را به طور منظم در معرض محتوای بالقوه غیرقانونی، خشونتآمیز یا مضر قرار میدهد. ما بارها و بارها شاهد آسیب های وحشتناکی بوده ایم که تعدیل محتوا می تواند بر مردم وارد کند. مثل پرداخت 52 میلیون دلار فیس بوک به مدیرانی که به دلیل آسیب های شغلی از PTSD رنج می برند.

کاهش بار ناظران انسانی میتواند به بهبود شرایط کاری آنها کمک کند. و از آنجایی که هوش مصنوعیهایی مانند GPT-4 در برابر استرس روانی که انسان هنگام مدیریت محتوای مشکلزا احساس میکند مصون است، میتوان بدون نگرانی در مورد فرسودگی شغلی و PTSD به کار گرفت.

با این حال، این سوال را ایجاد می کند که آیا استفاده از هوش مصنوعی به این روش منجر به از دست دادن شغل می شود یا خیر. تعدیل محتوا همیشه یک کار سرگرم کننده نیست. اما با این وجود یک شغل است. و اگر GPT-4 در این زمینه از انسان ها استفاده کند، احتمالاً این نگرانی وجود خواهد داشت که ناظران قبلی محتوا به جای تخصیص مجدد به نقش های دیگر، به سادگی بیکار شوند.

OpenAI در پست وبلاگ خود به این امکان اشاره نمی کند. و این واقعا چیزی است که پلتفرم های محتوا باید در مورد آن تصمیم بگیرند. اما ممکن است ترس از این که هوش مصنوعی توسط شرکت های بزرگ صرفاً به عنوان یک اقدام صرفه جویی در هزینه ها و بدون نگرانی برای عواقب بعدی به کار گرفته شود، چندان کمکی نکند.

با این حال، اگر هوش مصنوعی بتواند آسیبهای ذهنی را که تیمهایی که بیش از حد کار میکنند و مورد توجه قرار نگرفتهاند را کاهش دهد یا از بین ببرد که محتوای وبسایتهای مورد استفاده میلیاردها نفر را هر روز تعدیل میکنند، همه اینها میتواند چیزهای خوبی باشد. باید دید که آیا این امر با افزونگی های به همان اندازه ویرانگر تعدیل خواهد شد یا خیر.